当 AI 开始做科研:学者的危机与机遇

AI 正从科研工具演变为联合科学家,2025 年已能自主生成假设、设计实验。学者面临技能缺口、透明度危机与角色重定义三重挑战,需培养 AI 素养、跨学科与问题定义能力,并思考中国学者的转型路径。

摘要:AI4Science 正在从辅助工具演变为联合科学家,2025 年已出现能自主生成假设和设计实验的科研智能体;学者面临技能缺口、透明度危机和角色重新定义三重挑战;从 T 型人才转向网格型人才,培养 AI 素养和跨学科能力成为必修课。本文深度解读 AI4Science 的发展现状,并为中国学者提供转型思考框架。

2025 年 11 月,北京。一场汇聚中外院士和诺贝尔奖得主的国际会议上,一位年轻学者向诺贝尔经济学奖得主 James Heckman 提问:您认为人工智能会对我们这些未来科学家产生什么影响?

Heckman 的回答出人意料:高技能岗位反而更容易受到 AI 的冲击。

这句话像一记惊雷,让在座的 500 多位博士生陷入沉思。如果连科学家都不再安全,那什么工作才是安全的?

答案可能是:没有任何工作是安全的。但这不意味着末日来临,而是意味着一场深刻的转型已经开始。

从超级计算器到联合科学家

人类探索自然规律的方法论经历过四次变革:经验观察、理论推演、计算模拟、数据挖掘。如今,第五范式正在全面爆发。

这一次的主角是人工智能。但它的角色已经不再是科学家手中的计算器,而是正在演变为具备推理能力的联合科学家。

清华大学智能产业研究院院长张亚勤院士这样描述这一转变:AI 不仅将作为新语言和工具加速解决复杂科学难题,还会通过交叉学科融合反哺 AI 技术本身的突破。未来,AI 将不仅模拟人类智能,更会超越顶尖专家智能,重构科学发现体系。

这听起来像是科幻小说,但 2025 年的现实已经在印证这一判断。

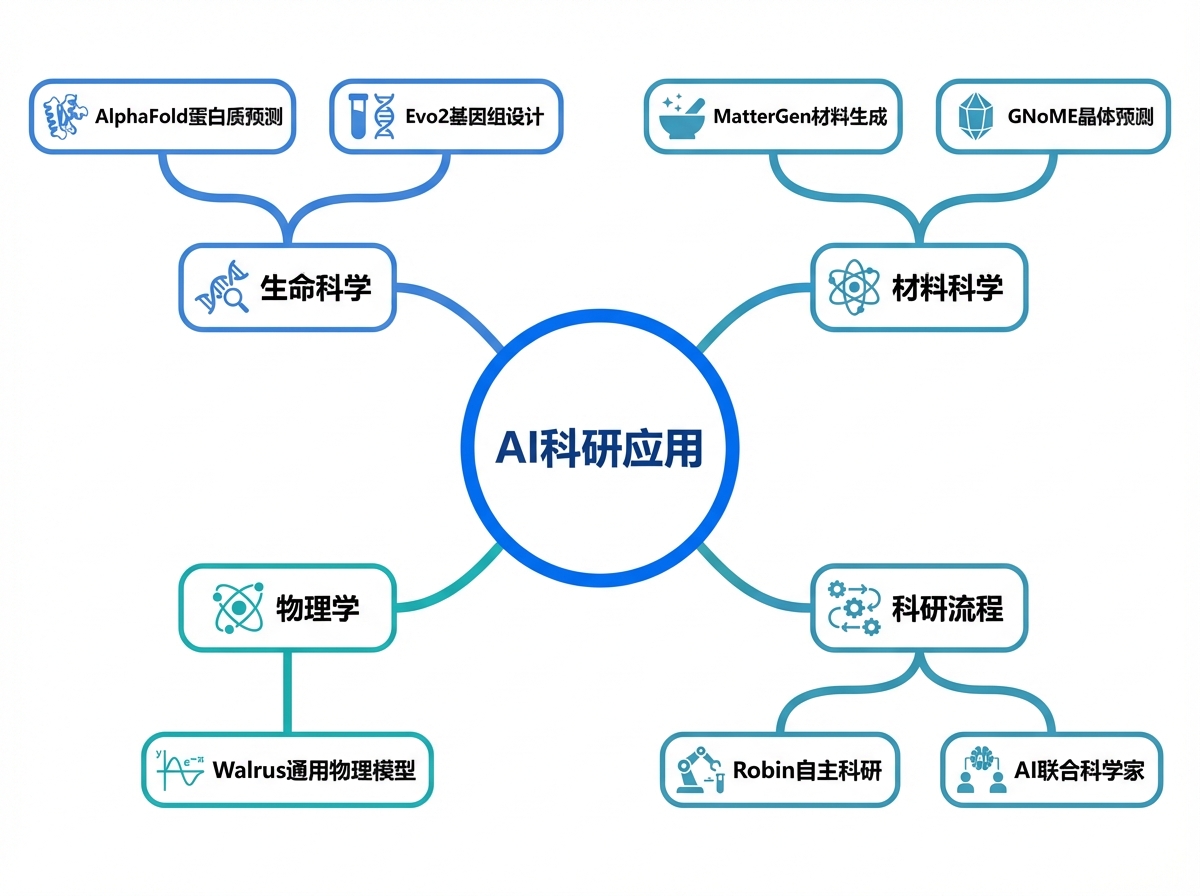

AI 已经在做什么

让我们看看 AI 在科研领域的最新战绩。

生命科学领域,AlphaFold 3 不再只是预测蛋白质结构,它已经能够模拟蛋白质与 DNA、RNA、小分子配体之间的复杂相互作用。这意味着什么?意味着药物设计的效率提升了 50% 以上。

更令人惊叹的是 Evo 2。这个基因组基础模型的训练数据覆盖了 10 万个物种,从细菌到人类,几乎涵盖了整个生命之树。它不仅能读懂基因密码,还能设计全新的基因编辑系统。

打个比方:如果 AlphaFold 是在翻译生命的硬件说明书,那么 Evo 2 就是在编写生命的操作系统。

材料科学领域,微软的 MatterGen 让材料设计从大海捞针变成按图索骥。你告诉它想要什么属性的材料,它直接生成满足条件的晶体结构。Google DeepMind 的 GNoME 更夸张,一口气预测了 220 万种新晶体,其中 38 万种可能稳定存在。人类花了几千年发现的稳定材料,AI 用几个月就扩展了近 10 倍。

物理学领域,Polymathic AI 的 Walrus 模型证明了一个惊人的事实:物理学存在通用特征。一个学会了模拟恒星爆炸的 AI,竟然也能用来模拟人体血液流动。这就像一个精通中餐的厨师,突然发现自己也能做法餐,因为烹饪的底层逻辑是相通的。

科研流程层面,变化更加直接。FutureHouse 开发的 Robin 系统可以从文献搜索开始,自主生成假设、设计实验、分析结果。Google 的 AI co-scientist 已经在斯坦福大学帮助发现了一种老药的新用途,就是治疗肝纤维化。这个发现,人类团队花了好几年才想到,AI 用了几天。

这些不是实验室里的概念验证,而是正在改变科研方式的现实工具。

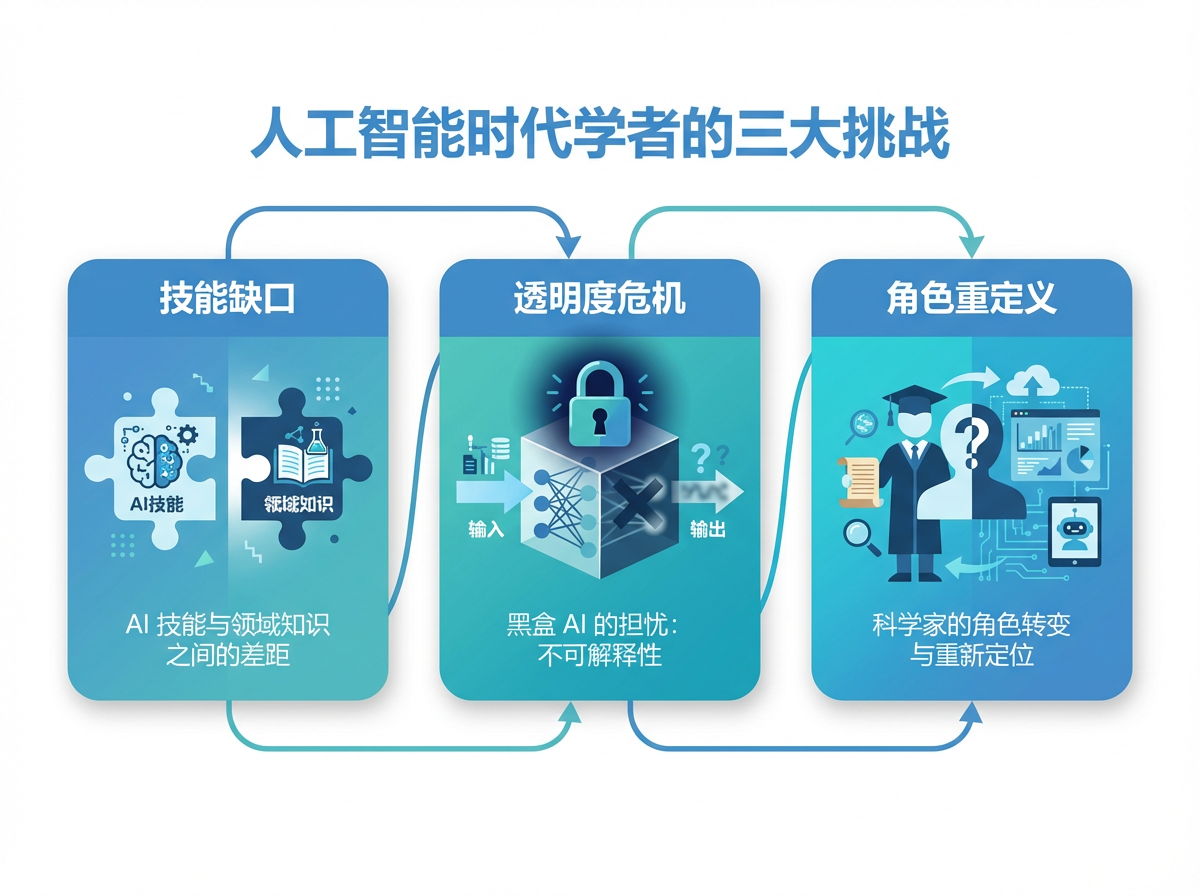

学者面临的三重挑战

面对这样的变革,今天的科研人员正在遭遇三重挑战。

第一重挑战:技能缺口

这是一个双重困境。传统科研人员往往缺乏高阶的 AI 技能,而 AI 工程师则缺乏深厚的领域科学知识。数据显示,AI 关键岗位的人才缺口高达 40% 到 60%。

更棘手的是,我们需要的是复合型人才。既懂蛋白质折叠动力学又精通 Transformer 架构的人,在就业市场上极其稀缺。这类人才成了各大科技公司和研究机构争抢的对象。

任正非在与青年科学家的对话中提到:随着大模型和智能体技术在软件开发中的广泛应用,AI 辅助编程已经释放了约 30% 的软件工程师工作量,未来可能达到 60% 到 70%。这意味着,常规性的编程工作正在被自动化,而更高层次的问题解决能力变得更加重要。

第二重挑战:透明度危机

斯坦福大学做了一项调查,给各大 AI 公司的透明度打分。满分 100,平均得分只有 40 分,比去年还低了。

这带来了一个严肃的科学问题:如果科学家使用无法获知训练数据来源、权重参数的封闭模型进行科学发现,那么这些发现的可复现性将大打折扣。

科学的根基是公开透明。黑箱 AI 可能导致科学研究变成一种依赖私有商业工具的特权活动。这与科学精神背道而驰。

第三重挑战:角色重新定义

这可能是最根本的挑战。当 AI 可以自动搜索文献、生成假设、设计实验时,科学家的角色是什么?

一个有趣的观察来自用户体验研究领域:研究者的角色正在从发现问题转向研究用户的创新。设计师不再设计单一的最佳流程,而是设计约束、默认值和护栏,让用户在其中自由创造。

这或许可以类比到科研领域。未来的科学家可能不再亲自跑实验、写代码,而是定义问题、设定约束、评估 AI 生成的假设和结果。这是一种更高层次的工作,但也意味着传统的科研训练方式需要根本性的改变。

未来科研人员必备的新能力

面对这些挑战,学者需要培养什么新能力?

AI 素养与批判性思维

这不是说每个科学家都要成为 AI 工程师。但你需要理解 AI 的运作原理、能力边界、局限性和偏见。更重要的是,你需要知道 AI 什么时候会产生幻觉,以及如何验证它的输出。

盲目相信 AI 输出是危险的。批判性思维在 AI 时代不是变得不重要,而是变得更加重要。

跨学科能力

AI 与医疗、金融、材料、能源等各行业正在深度融合。单一学科的专家越来越难以独立完成有影响力的研究。

北京信息科技大学的研究者提出了一个有趣的概念:从 T 型人才到 π 型人才,再到网格型人才。T 型人才是一专多能,π 型人才是两个领域都很深入,网格型人才则是在多个领域都有一定深度,同时能够在它们之间建立连接。

AI 时代需要的正是这种能在学科交叉点上工作的人才。

系统思维与问题定义能力

当 AI 可以快速执行任务时,定义正确的问题变得比解决问题更重要。这需要系统思维,也就是理解问题的上下文、识别关键变量、预见可能的后果。

就业重心正在从执行转向规划,从解决问题转向定义问题。

伦理判断能力

AI 在科研中的应用涉及数据隐私、算法偏见、研究诚信等一系列伦理问题。能够在技术开发和部署中进行负责任的伦理决策,将成为科研人员的核心素养。

转型路径:五个具体建议

说了这么多,学者到底应该怎么做?以下是五个具体建议。

第一,学会与 AI 协作

把 AI 当作研究伙伴而非威胁。学习使用 Elicit、Consensus 等文献工具,用 Claude 或 ChatGPT 辅助写作和编程,用专业的 AI 工具加速你的研究流程。

HUN-REN 的 CEO Roland Jakab 说得好:AI 不会取代研究者,但会使用 AI 的研究者会取代不会使用 AI 的研究者。在人工智能时代,学习能力是最重要的竞争优势。

第二,投资跨学科能力

如果你是生物学家,学一些机器学习;如果你是计算机科学家,深入了解一个应用领域。各大高校正在兴起 AI+法学、AI+教育学这样的微专业,这不是赶时髦,而是真实的人才需求在驱动。

第三,培养问题意识

花更多时间思考什么问题值得研究,而不是急于动手做实验。AI 可以帮你快速验证想法,但提出好问题仍然是人类的专长。

诺贝尔奖得主圆桌对话中有一个有趣的观点:创造性时刻是一种相变,是罕见事件。AI 很难在罕见事件上训练,这正是人类创造力的价值所在。

第四,保持学习状态

技术迭代是常态。今天学的工具,两年后可能就过时了。与其追逐具体工具,不如培养快速学习新工具的能力。

MIT Technology Review 在 2025 年末的一篇文章中引用 AI 研究者 Ilya Sutskever 的话:我们又回到了研究时代。大语言模型的边界性突破时代可能已经过去,但这意味着新范式的起点,而不是终结。

第五,参与开放科学运动

学术界正在发起 Open Science for Foundation Models 倡议,呼吁建立开源、透明的科学基础模型生态。参与这些运动,既是为科学共同体做贡献,也是确保 AI 发展不偏离科学精神的方式。

全球竞赛中的中国位置

当我们讨论 AI4Science 的未来时,不能忽视一个重要的背景:这已经是一场国家层面的竞赛。

2025 年底,美国政府发布了 Genesis Mission 行政令,将 AI 驱动的科学发现提升到曼哈顿计划级别的国家战略高度。该计划整合能源部下属国家实验室的算力、数据和实验设施,明确目标是利用 AI 加速生物技术、新材料、核聚变等关键领域的突破。美国人事管理局同时启动了技术人才计划,首批招聘 1000 名早期职业 AI 专家,薪酬高达 13 万至 19.5 万美元。

中国在这场竞赛中处于什么位置?

从基础设施看,中国正在加速建设 AI 科学计算平台。HUN-REN 匈牙利研究网络的新超级计算机将建在 Wigner 物理研究中心,而中国的国家超算中心同样在为 AI4Science 提供算力支撑。从人才储备看,斯坦福大学的 AI 人才追踪数据显示,中国在培养 AI 精英研究人员方面已接近与美国匹敌的水平,越来越多的人选择留在中国或返回中国。

更值得关注的是中国在应用层面的探索。2025 年 11 月,北京中关村学院与中关村人工智能研究院联合清华大学、西湖大学举办了国际人工智能科学家大会。会上发布了 OmniScientist,这是全球首个助力科研人才全流程培养的科研智能体系统。这套系统以元科学洞察与学者数字孪生为核心,目标是成为青年科学家成长道路上的共创伙伴。

张亚勤院士在会上说了一句意味深长的话:AI for Science 是 AI 的机遇,是科学的机遇,也是中国与全球的机遇。

这句话值得每一位中国学者深思。

中国学者可以做什么

第一,善用本土资源

中国有独特的优势:庞大的科研人员队伍、丰富的应用场景、完整的产业链条。中国学者应该善于利用这些资源。比如,清华大学 AIR 正在推动的 OmniScientist 系统,就是一个值得关注的本土工具。国内的 AI 企业如百度、阿里、华为也都在开发面向科研场景的 AI 工具。

不要只盯着 OpenAI 和 Google。在某些垂直领域,中国的 AI 工具可能更适合中国学者的需求。

第二,重视产学研协作

任正非在与青年科学家的对话中强调,学校和企业需要密切合作。华为的冠军杯编程竞赛就是一个例子,题目来源于工业界,冠军是学术界的博士生。这种合作模式应该成为常态。

中国学者不妨主动走出象牙塔,与企业建立联系。企业有数据、有算力、有应用场景;学者有方法论、有创新思维、有学术资源。双向奔赴,才能在 AI4Science 的浪潮中站稳脚跟。

第三,警惕两个极端

一个极端是技术狂热。有人认为 AI 可以解决一切问题,于是盲目追逐热点,把 AI 硬塞进不适合的研究场景。另一个极端是技术恐惧。有人担心 AI 会取代自己,于是拒绝学习,固守传统方法。

北京信息科技大学的孟坤教授说得好:技术迭代是变的常态,但求真严谨的学风与解决现实问题的初心是不变的核心。既不要被技术绑架,也不要被技术抛弃。

第四,培养下一代的方式要变

如果你是导师,需要思考一个问题:你培养的学生毕业后要面对的,是一个 AI 深度融入科研的世界。传统的培养方式,也就是手把手教实验操作、一行行改代码,可能已经不够了。

你需要教会学生的,是如何与 AI 协作、如何评估 AI 输出、如何在 AI 辅助下保持批判性思维。中关村学院的严俊主任提出了一个概念:明确 AI 使用的正面清单与负面清单。这是一个值得借鉴的思路。

第五,参与规则制定

AI4Science 的全球规则正在形成之中。中国学者不应该只是规则的接受者,也应该成为规则的参与制定者。

这包括:参与国际学术组织的讨论、在顶级期刊发表观点文章、推动建立符合中国国情的 AI 科研伦理规范。开放科学运动中,中国的声音应该更响亮。

结语:科学家的新定义

这场竞赛不仅发生在国家层面,也发生在每一位科研人员身上。

在那场北京的国际会议上,面对 Heckman 教授关于高技能岗位更容易受冲击的判断,一位年轻学者追问:那我们应该怎么办?

Heckman 的回答出人意料地乐观:我并不认为我们会失去所有这些工作。当新技术赋能科学家更好地检索文献、解读资料、修正工作时,我们其实是在创造新的岗位、新的任务、新的可能性。真正被淘汰的,往往是那些缺乏动力去学习新技能的人。

同场的诺贝尔物理学奖得主 Konstantin Novoselov 则给出了另一个视角:真正的创造性突破是一种相变,是罕见事件。AI 很难在这些罕见事件上训练,这正是人类创造力的价值所在。

这或许是 AI 时代学者最需要记住的一句话。

AI 不会取代科学家,但它正在重新定义什么是科学家。

一百年前,科学家的形象是爱因斯坦在黑板前写公式。五十年前,是穿着白大褂在实验室里摆弄试管。二十年前,是对着电脑屏幕分析数据。

下一个时代的科学家会是什么样子?也许是一个善于提问的人,一个能够定义问题边界的人,一个懂得如何与机器智能协作的人。

技术在变,但科学的本质没有变,它仍然是人类理解世界的努力。只是现在,我们有了一个前所未有的伙伴。

问题是:你准备好迎接这个伙伴了吗?

参考来源:

- 诺奖桂冠得主圆桌交锋:共探 AI 时代的科学未来|国际 AI 科学家大会 2025 高端圆桌

- 2025 国际人工智能科学家大会 (ICAIS 2025)

- 清华大学智能产业研究院 (AIR)

- Google Research 2025: Bolder breakthroughs, bigger impact

- NeurIPS 2025 AI for Science Workshop

- 斯坦福大学基础模型透明度指数

- 美国白宫 Genesis Mission 行政令

- FutureHouse Robin 系统

- Microsoft MatterGen 研究

- Google DeepMind AlphaFold

- Polymathic AI Walrus 模型