21.6 学术诚信与常见误区

面向经管学生、研究者与从业者的 AI 智能体设计教材

AI 辅助研究不是让 AI 替研究者完成研究,而是研究者主导、AI 执行。研究设计、假设识别、样本边界、结论措辞,这些判断性工作必须由研究者亲自做。AI 的价值在于把机械性、重复性工作自动化,让研究者把精力集中在真正需要学术判断的节点上。边界是否划清,直接影响 AI 辅助研究能否被同行接受、团队产出能否经得起复现检验。这一节明确人在回路(HITL)的五大节点、AEA 及主流期刊的披露要求、复现包提交清单,以及五个最常见的误区。

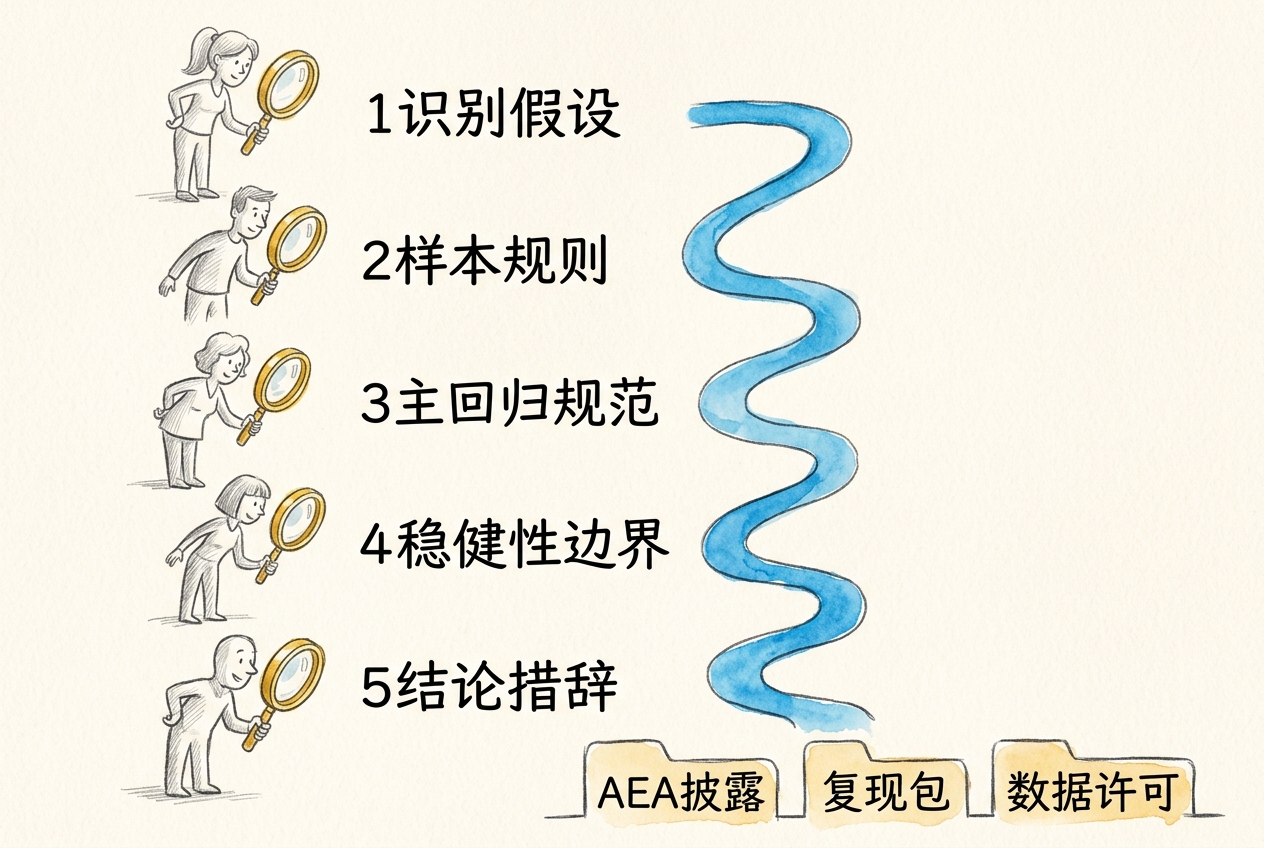

五大 HITL 节点

实证研究有五个节点必须由研究者亲自把关。这些判断本质上是关于因果逻辑、研究设计和学术诚信的,AI 无法独立完成。

| 节点 | 为什么不能自动化 |

|---|---|

| 1. 识别假设与研究设计 | 因果逻辑是研究核心,AI 无法判断哪种识别策略适合特定问题;是否承认平行趋势、是否接受 IV 的排除限制,是研究者的专业判断 |

| 2. 样本构造规则 | 年份范围、行业筛选、地区排除直接决定研究结论的外部效度;哪些单元是合理控制组、哪些是异常值,需要领域知识 |

| 3. 主回归规范 | 固定效应结构、聚类层级、控制变量集都是研究者的判断;AI 可以执行任意规范,但规范本身必须由人选定 |

| 4. 稳健性矩阵的边界 | AI 可以跑完矩阵里的每个格子,但哪些检验需要做、哪些维度值得强调,由研究者基于对审稿人关切的理解决定 |

| 5. 最终表格与结论措辞 | 表格里的每个数字都要研究者亲自核对;结论的措辞分寸——“显著降低”还是”无显著影响”——不能外包给 AI |

这五个节点的共同特征是:输出质量无法通过自动化规则检验,需要研究者对该领域的学术共识、期刊偏好、审稿人视角有判断。Hooks 和 Skills 可以在这些节点强制暂停,把决策权交还给研究者。

AEA 及主流期刊的 AI 使用披露

AEA、QJE、ReStat 等主流经济学期刊自 2024-2025 年起陆续发布 AI 使用政策。核心要求有三条:

- 工具披露:在论文致谢或方法脚注中注明使用了哪些 AI 工具(如 Claude Code、ChatGPT),用于哪些具体任务(代码生成、数据清洗、表格格式化、语言润色等)

- 责任承担:作者对所有分析结果负完全责任,AI 的输出必须经研究者独立核验

- 禁止署名:AI 工具不能作为论文合作者(co-author),不能在致谢外声明”贡献”

下面给出中英双语致谢段模板,可以直接放在论文 Acknowledgements 末尾:

【中文模板】

本文在数据清洗脚本、回归代码调试、表格格式化环节使用了 Anthropic

Claude Code 作为辅助工具。所有分析结果、稳健性检验与结论解读均由

作者独立核验。AI 工具未参与研究设计、识别假设选择或结论撰写。作者

对本文全部内容承担学术责任。【English Template】

The authors used Anthropic Claude Code for data cleaning scripts,

regression code debugging, and table formatting. All empirical results,

robustness checks, and interpretations were independently verified by

the authors. AI tools were not involved in research design, identifying

assumption selection, or the drafting of conclusions. The authors take

full academic responsibility for all content.审稿人不反对使用 AI,反对的是模糊披露。“使用了 AI 辅助”这种笼统表述会让审稿人怀疑范围过大。具体到哪一步(清洗、回归调试、表格)、哪些输出经过研究者核验,是自我保护的最佳方式。各期刊政策细节可能更新,投稿前务必查阅期刊最新 AI 使用指南。

复现包提交清单

AEA Data Editor 按 DCAS v1.0 规范审核每篇发表论文的复现包。在投稿前自检以下九项,可以避免 90% 的退回修改:

WRDS、Wind、CSMAR 等受许可数据禁止纳入复现包。正确做法是提供数据获取脚本(例如 WRDS 的 SAS 查询语句)或详细的变量构造说明,让第三方研究者在自行获得数据许可后能重建样本。AEA Data Editor 接受这种处理,但要求说明必须足够详细,仅写”数据来自 WRDS”不合格。

AI 方法选择的局限性

APEP(Autonomous Policy Evaluation Papers)项目提供了一个直观的反面案例。苏黎世大学 Social Catalyst Lab 让 AI 智能体全自动完成从识别政策问题到撰写论文的全流程,截至 2026 年 3 月已产出 592 篇论文。Paul Goldsmith-Pinkham 分析后发现,其中 73.8% 至少三次提及 DID,远超 NBER 工作论文中的对应比例。这说明 AI 在全自动模式下会过度偏向 DID 这类”即插即用”的因果识别方法,缺少研究者对方法适配性的判断。Goldsmith-Pinkham 的评论一针见血:“很难进行因果政策评估,需要人类品味和判断。”这正是为什么”识别假设与方法选择”被列为五大 HITL 节点中的第一个——方法选择不能交给 AI 自动决定。

五个常见误区

以下是实证研究中使用 AI 最容易踩的五个坑,列在这里作为长期提醒。

AI 跑完稳健性矩阵后会生成几张 LaTeX 表。把表里的数字直接贴进论文正文,常常被审稿人发现样本量和主表对不上——某一列因为样本筛选掉了一些观察值,N 从 10000 跌到 8500。正确做法是每张表都人工核对 N、R² 和关键系数,任何不一致都要追溯到具体筛选语句。

Card-Krueger (1994) 最低工资数据、Angrist-Krueger (1991) 学校入学数据、Lalonde (1986) NSW 实验数据,这些数据集在 LLM 训练语料中出现过无数次。让 LLM 分析时它可能在复述记忆的表格而不是真在跑回归。若要展示方法,用公开但非经典的数据(如 QCEW 或 FRED 近年数据)更安全;若必须用经典数据,在 LLM 未见过的新年份或新子样本上复现结果作为验证。

Wind、CSMAR、WRDS 的原始文件一旦通过复制粘贴或附件形式进入 Claude Code 会话,就已经违反了许可协议——即使只是让 AI 看一眼字段结构。正确做法是在本地环境跑 Stata,把脱敏的变量清单和几行假数据样例发给 AI,让它基于字段名写处理脚本。原始数据永远不离开本地机器。

csdid 的 bootstrap、sdid 的 placebo 推断、任何 permutation test 都依赖随机抽样。若没有 set seed 20260417,每次跑稳健性得到的标准误和 p 值都会轻微变动,有时把显著性从 5% 挤到 10% 之外。CLAUDE.md 里明确规定所有随机过程必须固定种子,Hooks 里加 PreToolUse 扫描,能把这个风险降到接近零。

审稿人报告里最高频的问题之一是”标准误是怎么聚类的”。主表脚注必须明确写出聚类层级(州、行业、州×年等),且稳健性里做过的不同聚类方案也要报告。把聚类选择写进 .claude/rules/regression-spec.md,让 AI 在生成表格时自动把聚类信息加进脚注,能避免投稿后被要求重跑整套回归。

这五个误区都不是 AI 本身的问题,而是人机协作边界没划清造成的。把边界写进 CLAUDE.md、rules 和 Hooks,研究者就能把精力留给真正需要判断的地方。