用户将一篇 PDF 论文放入 inbox/,希望制作成学术汇报 PPT。论文是经典的 Attention Is All You Need(Vaswani et al., 2017),目标是 15-20 页的英文课堂/组会演示文稿,包含架构图、公式推导和代码示例。

用户在对话中输入:

inbox 里有一篇论文 paper.pdf,帮我做成学术汇报 PPT,英文,15-20 页,课堂/组会用,要有架构图、公式推导和代码示例

交互过程

Claude 收到指令后,先扫描 inbox/ 目录。发现 PDF 文件无法直接读取内容,于是自动调用 mineru Skill 将论文转为 Markdown。

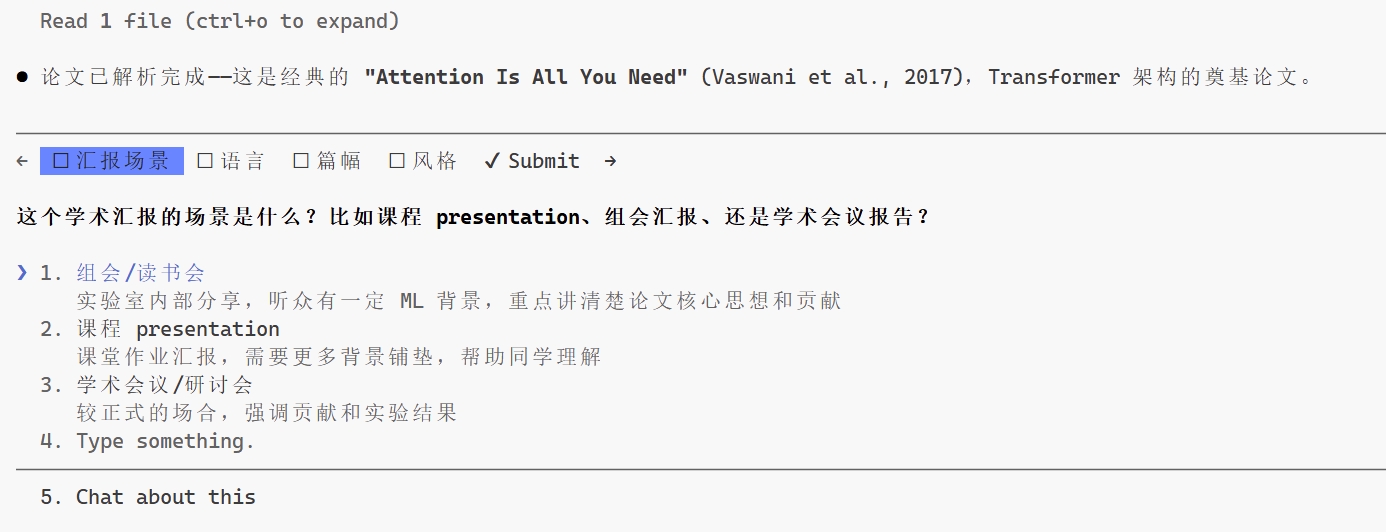

解析完成后,Claude 识别出这是 Transformer 架构的奠基论文。由于学术汇报 PPT 的内容侧重因场景而异,Claude 通过 AskUserQuestion 工具向用户确认汇报场景。选项包括组会/读书会、课程 presentation、学术会议/研讨会三种,每种场景对背景铺垫和内容深度的要求不同。

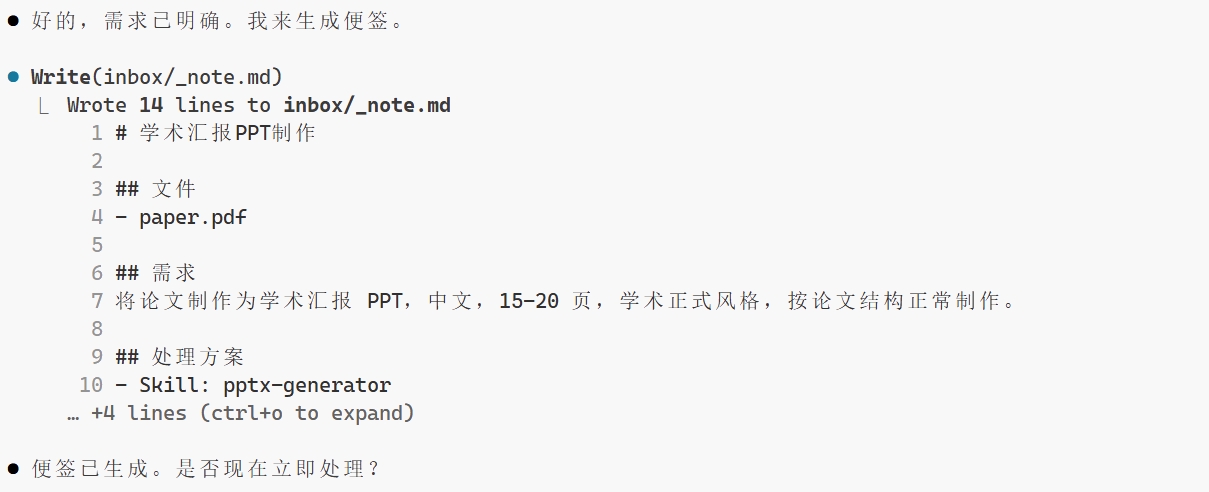

用户选择后,Claude 综合论文内容和场景需求,生成一张便签 task-Transformer论文学术汇报PPT.md,记录文件、需求和处理方案。

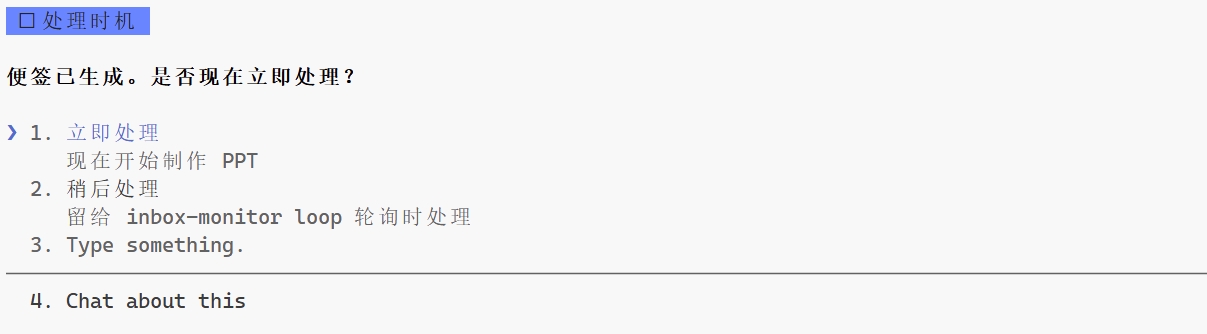

便签生成后,Claude 按照 inbox-interaction 规则,询问用户是否立即处理。用户可以选择立即开始,也可以留给 inbox-monitor Loop 在下一轮轮询时自动拾取。

产出物

最终产出一份 18 页英文 PPT,保存在 tasks/2026-04-16-Transformer论文学术汇报PPT/ 目录下。PPT 结构完整:封面、目录、背景与动机、模型架构总览、Scaled Dot-Product Attention 公式推导、Multi-Head Attention 机制详解、位置编码、代码示例、实验结果对比、结论与贡献。

组件链路

这个场景串联了以下组件:

flowchart LR

A[确认用户意图] --> B[生成任务卡片]

B --> C[mineru Skill<br>PDF 转 Markdown]

C --> D[pptx-generator Skill<br>生成 PPT]

D --> E[更新任务日志]

flowchart LR

A[确认用户意图] --> B[生成任务卡片]

B --> C[mineru Skill<br>PDF 转 Markdown]

C --> D[pptx-generator Skill<br>生成 PPT]

D --> E[更新任务日志]

两个 Skill 接力完成任务:mineru 负责将 PDF 论文转为结构化 Markdown,pptx-generator 基于 Markdown 内容按学术汇报格式生成 PPT。整个过程中,inbox-interaction 规则控制交互流程,task-changelog 规则确保任务完成后日志同步更新。